شبکه عصبی کانولوشنی LeNet

- دسته:اخبار علمی

- هما کاشفی

شبکه عصبی کانولوشنی LeNet یکی از اولین شبکه های عصبی کانولوشنی است که با مفهوم یادگیری عمیق توسط yan lecun معرفی شد. این شبکه ساختاری پنج لایه دارد به نام lenet-5 معروف است و اولین بار برای تشخیص ارقام دست نویس mnist استفاده شد. در این پست به طور مختصر رویکرد و مزایای شبکه LeNet را بررسی میکنیم.

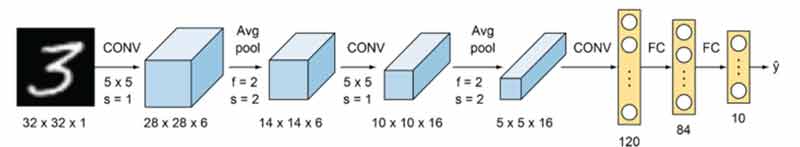

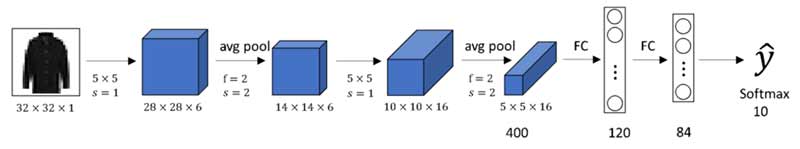

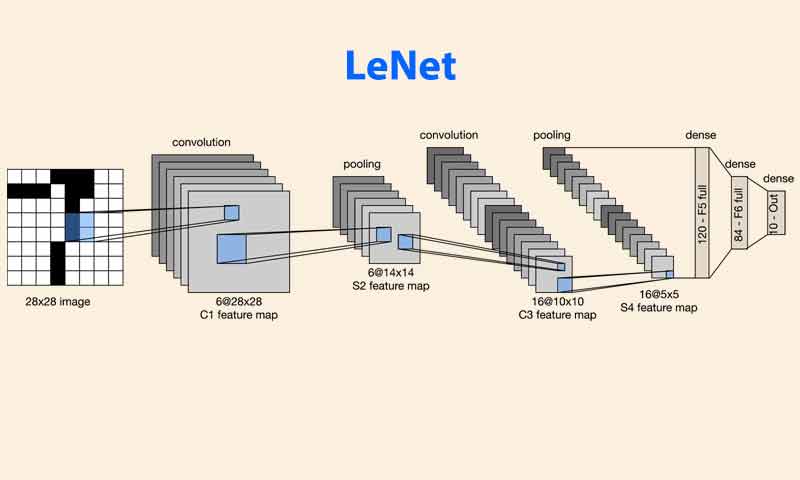

شبکه عصبی LeNet اولین بار برای تشخیص ارقام چاپ شدهی ماشینی و ارقام دست نویس توسط Yann LeCun, Leon Bottou, Yosuha Bengio, Patrock Haffner در سال 1990 معرفی شد و نام اصلی آن LeNet-5 بود. دیتاستی که برای این معماری استفاده شد MNIST بود. معماری این شبکه بسیار ساده و درک آن آسان است. تصاویر ورودی gray Scale بوده و ابعاد 32*32*1 دارند. سپس دو لایهی کانولوشن با stride=2 و لایه Average Pooling با stride=1 قرار دارد. در انتهای شبکه لایههای Fully Connected با تابع فعالسازی Softmax در لایهی خروجی قرار دارند. تعداد پارامترهای این شبکه 60000 است.

LeNet-5 را میتوان از اولین شبکههای عصبی کانولوشنی دانست که از مفهوم یادگیری عمیق استفاده کرده بود. در سال 1989، Yann LeCun و همکارانش یک شبکه عصبی کانولوشنی آموزش دیده با قاعده Backpropagation را برای اسکن ارقام دست نویس استفاده کردند و از این شبکه بعدها برای تشخیص ارقام کد پستی دست نویسی استفاده کردند که توسط سرویس ارتباطات ایالات متحده ارائه شده بود. این اولین کاربرد شبکه LeNet-5 بود. در همان سال LeCun در مقالهای دیگر ناهنجاری کوچکی در تشخیص ارقام دست نویس را توضیح داد و اثبات کرد که شبکههای تک لایه قابلیت تعمیم ضعیفی دارند.

ویژگیهای مهم شبکه LeNet-5

- هر لایهی کانولوشنی از سه بخش تشکیل شده: کانولوشن، pooling و تابع فعالسازی غیرخطی

- از کانولوشن برای استخراج ویژگیهای مکانی استفاده شده است

- لایهی average pooling که به نوعی عملیات Subsampling را انجام میدهد

- تابع فعالسازی tanh

- استفاده از شبکه عصبی پرسپترون چند لایه به عنوان کلاسبند نهایی

- اتصالات تنک بین لایهها برای کاهش پیچیدگی محاسباتی

اگر علاقه مند به یادگیری تخصصی شبکه عصبی CNN هستید پیشنهاد میکنیم که دوره جامع و پروژه محور شبکه عصبی کانولوشنی را بگذارنید. در این دوره تئوری و ساختار این شبکه کامل توضیح داده شده و سپس به صورت پروژه محور پیاده سازی شده است.

دیدگاه ها