پکیج کامل پیادهسازی گام به گام شبکههای عصبی

- دسته:پکیجهای آموزشی, شبکههای عصبی, متلب

- 0 دیدگاه

در دوره جامع شبکه عصبی تمامی شبکههای عصبی صفر تا صد آموزش داده شده و سپس مرحله به مرحله بدون اینکه از تولباکس آماده استفاده کنیم، پیاده سازی میشوند. برای اینکه بتوانید یک شبکهای را در متلب پیادهسازی کنید لازم است که در ابتدا مباحث تئوری هر الگوریتم را یاد بگیرید. ما طبق کتاب معروف سیمون هیکن که یک کتاب مرجع در اکثر دانشگاههای داخل و خارج کشور است، مباحث تئوری را آموزش میدهیم، بعد از آن مرحله مرحله الگوریتمها را در متلب پیادهسازی میکنیم و سپس چندین پروژه عملی انجام می دهیم. در این دوره تمرکز ما روی سه موضوع بوده است: تئوری و مباحث ریاضیاتی، پیادهسازی گام به گام، پروژه عملی

معرفی دوره ی پیادهسازی شبکههای عصبی در متلب

درس شبکه عصبی پایهی اصلی مباحث یادگیری ماشین و هوش مصنوعی است و هر دانشجوی مهندسی لازم است که در ابتدا با گذراندن این دوره وارد حوزه هوش مصنوعی و یادگیری ماشین شود. دوره های زیادی در کشور برگزار می شود ولی بیشتر این دوره ها تخصصی نیستند و یک سری ایراداتی دارند: آموزش تولباکس محور به جای پیادهسازی الگوریتمها، عدم پیادهسازی مقالات تخصصی، عدم انجام پروژه های تخصصی. افرادی که در چنین دوره هایی شرکت می کنند عملا هیچ کاری به جز استفاده تولباکسی اونم درحد محدود نمیتوانند انجام دهند. شبکه عصبی یک درس تخصصی است که شرکت کننده باید تمام مباحث مرتبط را یاد بگیرد تا بتواند از این شبکه ها به نحو احسن استفاده کند. این دوره اولین دوره تخصصی در ایران است که بر پایه 4 اصل بنا شده است: آموزش مباحث تئوری، آموزش پیادهسازی الگوریتمها، آموزش پیادهسازی مقالات تخصصی، آموزش نحوه انجام پروژه های تخصصی.

در این دوره ما صفر تا صد شبکه ها را پیادهسازی میکنیم و دانشجو برای اینکه بتواند یک شبکهای را در متلب پیادهسازی کند لازم است که در ابتدا مباحث تئوری هر الگوریتم را یاد بگیرد. ما طبق کتاب معروف سیمون هیکن که یک کتاب مرجع در اکثر دانشگاههای داخل و خارج کشور است، مباحث تئوری را آموزش میدهیم، بعد از آن مرحله مرحله الگوریتمها را در متلب پیادهسازی میکنیم و برای اینکه دانشجو با کاربردهای عملی این شبکه ها آشنا شود چندین پروژه عملی در اکثر حوزه انجام می دهیم. اولین وجه تمایز این دوره با سایر دورهها این است که تولباکس محور نیست و تمامی الگورتیمها در متلب پیادهسازی می شوند. دومین وجه تمایز آن انجام پروژههای تخصصی است. تولباکسهای متلب محدود است و اگر دانشجو فقط تولباکس محور شبکه ها را یاد بگیرد با چند مشکل اصلی در آینده مواجه میشود: 1- عدم یادگیری مباحث تئوری به صورت تخصصی، 2- عدم تسلط به مباحث و در نتیجه اگر محیط برنامه نویسی عوض شود نمیتواند در محیط جدید کاری انجام دهد. 3- عدم پیادهسازی الگوریتمهای پیشرفته. از آنجا که فرد فقط تولباکس محور یاد گرفته است، در نتیجه با جزئیات و چالشهای پیادهسازی الگوریتمها را یاد نخواهد گرفت و در نتیجه نمیتواند با دانشی که کسب کرده است پروژه تخصصی و یا مقاله تخصصی پیادهسازی کند!

دانشجویانی که دوره تخصصی گروه ما را می گذارنند دیگر مشکلی در پیادهسازی مقالات تخصصی، پیادهسازی پروژههای تخصصی، و ارائه ایدههای نو نخواهند داشت. به دوستانی که میخواهند وارد حوزه هوش مصنوعی و یادگیری ماشین شوند توصیه میکنیم حتما با این دوره تخصصی شروع کنند.

این دوره کاملا پروژه محور بوده و در طول دوره پروژههای مختلفی با شبکه های عصبی انجام میشود. در این دوره نحوه پیادهسازی شبکههای عصبی آموزش داده میشود و مطمئنا شرکتکنندگان بعد از تمرین و تکرار مطالبی که آموزش داده میشود، در پیادهسازی شبکهها، بهبود شبکهها، شبیهسازی مقالات و استفاده از شبکهها در پروژههای عملی چالشی نخواهند داشت.

در دوره ی پیاده سازی شبکههای عصبی مصنوعی در متلب سعی بر این است که تمام مباحث کتاب معروف Simon Haykin آموزش داده شود. کتاب معروف Simon Haykin، کتابی استاندارد برای یادگیری شبکههای عصبی است که در بیشتر دانشگاههای داخل و خارج کشور تدریس میشود.

در ابتدای هر جلسه، مباحث تئوری کتاب آموزش داده میشود و سپس به طور گام به گام در متلب پیادهسازی میشود. و در نهایت با استفاده از شبکه پیاده سازی شده در هر جلسه چندین پروژه تخصصی انجام می شود تا با انجام پروژه تخصصی هم آشنا شوید و بتوانید پروژه تخصصی خودتان را با کمک شبکههای عصبی انجام دهید.

اهداف دوره شبکه عصبی:

- یادگیری مفاهیم هوش مصنوعی و یادگیری ماشین

- یادگیری مباحث تئوری شبکههای عصبی

- پیادهسازی مرحله به مرحله شبکههای عصبی نظارت شده

- انجام پروژه های تخصصی

- پیادهسازی مقالات تخصصی

سرفصل دوره شبکه عصبی:

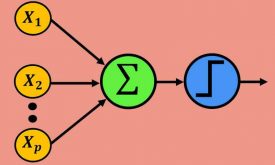

1. آموزش مفاهیم پایه هوش مصنوعی و یادگیری ماشین، معرفی نورون بیولوژیکی و بررسی عملکرد آن و مدلسازی نورون مصنوعی

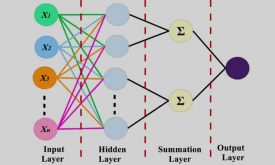

2. آموزش مباحث تئوری شبکه عصبی پرسپترون تک لایه و پیادهسازی مرحله به مرحله آن در متلب، بررسی عیب قانون یادگیری پرسپترون و معرفی کلاسبند ماکزیمم شباهت و پیادهسازی مرحله به مرحله آن در متلب

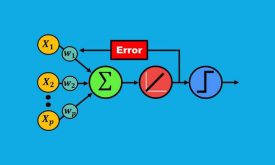

3. بررسی عیب کلاسبند ماکزیمم شباهت و معرفی قانون یادگیری حداقل مربعات خطا(LMS)، پیادهسازی قانون یادگیری LMS با دو روش وینر هاف و گرادیان نزولی(gradient descend)، بررسی عیب قانون یادگیری وینرهاف و گرادیان نزولی، آموزش مباحث تئوری شبکه عصبی آدالاین(adaline) تکلایه و پیادهسازی مرحله به مرحله آن در متلب، بررسی عیب شبکههای عصبی تک لایه و آموزش پارامترهای ارزیابی شبکه

4. آموزش مباحث تئوری شبکه عصبی پرسپترون چند لایه(MLP) و پیادهسازی مرحله به مرحله آن در متلب

5. بررسی عیب قانون یادگیری پس انتشار خطا(Back propagation)

6. آموزش مباحث تئوری شبکه عصبی پرسپترون چند لایه با قانون یادگیری دلتا دلتا (delta delta rule)و پیادهسازی مرحله به مرحله آن در متلب

7. آموزش مباحث تئوری شبکه عصبی پرسپترون چند لایه با قانون یادگیری دلتا بار(delta bar delta rule) و پیادهسازی مرحله به مرحله آن در متلب

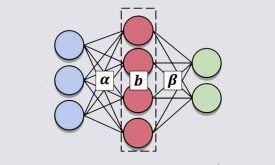

8. آموزش مباحث تئوری شبکه عصبی RBF و پیادهسازی مرحله به مرحله آن در متلب

9. آموزش مباحث تئوری شبکه عصبی ELM و پیادهسازی مرحله به مرحله آن در متلب

10. آموزش مباحث تئوری شبکه عصبی PNN و پیادهسازی مرحله به مرحله آن در متلب

این دوره تنها یک ویدیوی آموزشی نیست، بلکه پروژه ها و مقالات زیادی در این دوره آموزشی پیاده سازی شده اند که میتوانید از آنها در پروژههای درسی و پایان نامه خودتون استفاده کنید!

پروژههای انجام شده در این پکیج آموزشی:

- آموزش روشها و پارامترهای ارزیابی شبکههای عصبی

- ناحیهبندی تصویر با استفاده از شبکههای عصبی

- مدلسازی گیتهای منطقی با استفاده از شبکههای عصبی (مدلسازی)

- انجام پروژه تشخیص سرطان سینه با استفاده از شبکههای عصبی(کلاسبندی داده دوکلاسه)

- انجام پروژه تشخیص نوع برگ درختان با استفاده از شبکههای عصبی(کلاسبندی داده های چندکلاسه)

- انجام پروژه تشخیص میزان آلودگی هوا با استفاده از شبکههای عصبی (رگرسیون)