الگوریتمهای یادگیری عمیق در پردازش سیگنال EEG

- دسته:اخبار علمی

- هما کاشفی

در سالهای اخیر، الگوریتمهای یادگیری عمیق به سرعت توسعه یافتهاند و در حال تبدیل شدن به ابزاری قدرتمند در مهندسی پزشکی هستند. به طور خاص، تمرکز زیادی بر کاربرد الگوریتمهای یادگیری عمیق در رمزگشایی وضعیت فیزیولوژیکی یا پاتولوژیک مغز از الکتروانسفالوگرافی (EEG) شده است. در این مقاله، کاربرد فعلی الگوریتمهای یادگیری عمیق در انواع تسکهای رمزگشایی EEG بررسی میشود. در این مقاله، اصول اولیه الگوریتمهای یادگیری عمیق مورد استفاده در رمزگشایی EEG به طور خلاصه شرح داده شده است از جمله شبکه عصبی کانولوشنی (CNN)، شبکه باور عمیق (DBN)، شبکه خودرمزنگار (autoencoder) و شبکههای عصبی بازگشتی (RNN).

مقدمه:

الکتروانسفالوگرافی (EEG) یک فعالیت الکتریکی ریتمیک و خود به خود مغز است. EEG به دلیل سادگی، سهولت استفاده و رزولوشن بالای سیگنال نقش بسیار مهمی در تحقیقات بالینی داشته است. برای مثال EEG را میتوان به عنوان شاخصی برای تشخیص و پایش بیماریهایی مانند صرع و اختلالات خواب در کاربردهای بالینی استفاده کرد. EEG یک متد تصویربرداری مغز است که از الکترودهای متصل به سطح پوست سر برای شناسایی و ثبت فعالیت الکتریکی مغز استفاده میکند که با استفاده از آن میتوان در مورد شناخت مغز، ایدههایی کسب کرد.

در مقایسه با سایر متدهای تصویربرداری مغز مانند ثبت فعالیت عصبی داخل قشر مغز، طیف سنجی عملکردی مادون قرمز نزدیک (fNirs) و تصویربرداری رزونانس مغناطیسی (mri)، سیگنال EEG در پژوهشها و توسعه تجهیزات توانبخشی مانند واسط مغز و کامپیوتر (BCI) و فناوریهای بازخورد عصبی استفاده شده است. در کاربردهای بالینی فوق و تحقیقات علمی EEG، الگوریتمهای یادگیری ماشین اغلب برای رمزگشایی دقیق سیگنالهای EEG استفاده میشوند با این حال رزولوشن مکانی پایین و نرخ سیگنال به نویز پایین سیگنالهای EEG، باعث شدهاند الگوریتمهای یادگیری ماشین با محدودیتهای بیشتری روبرو شوند.

الگوریتمهای سنتی یادگیری ماشین برای رمزگشایی EEG

انواع الگوریتمهای کلاسیک یادگیری ماشین مانند مدلهای مخفی مارکوف (HMM)، الگوریتم LDA و ماشینهای بردار پشتیبان (SVM)، K نزدیکترین همسایه (KNN)، و شبکههای عصبی مصنوعی (ANN) و غیره عمدتاً در تشخیص و رمزگشایی سیگنالهای EEG استفاده میشوند که در آنها LDA و SVM محبوبترین کلاسبندها در کاربردهای BCI هستند زیرا برای رمزگشایی EEG بلادرنگ و آنلاین بسیار مناسب هستند.

پایه و اساس یادگیری عمیق، شبکههای عصبی هستند که در آنها یک یا دو لایهی پنهان از پرسپترون چندلایه (MLP) وجود دارد. برای رمزگشایی BCI، میتوان از این شبکهها برای تشخیص تشنجهای صرع استفاده کرد. الگوریتمهای یادگیری ماشین در رمزگشایی EEG با محدودیتهایی روبرو هستند. بری مثال، در کاربردهای سنتی رمزگشایی EEG، استخراج ویژگی و کلاسبندی ویژگیها به طور جداگانه انجام میشوند و بدست آوردن تجربه یا دانش قبلی در مورد آنها دشوار است. در این حالت، طبقه بندی و استخراج ویژگی با هم ترکیب میشوند و پردازش سیگنال EEG به یک مرحله ترکیب میشود. کلاسبندی یک استراتژی عملی است و دلیل اصلی است که چرا از الگوریتمهای یادگیری عمیق در رمزگشایی EEG در سالهای اخیر استفاده شده است.

رمزگشایی EEG با استفاده از الگوریتمهای یادگیری عمیق

یادگیری عمیق یک پارادایم یادگیری ماشین است که تنها بر مدلهای داده یادگیری سطح عمیق تمرکز دارد. در یادگیری عمیق عمدتاً از معماری با تعدادی لایه پنهان عمیق استفاده میشود و همچنین از واحدهای پردازش غیرخطی برای استخراج و تبدیل ویژگی استفاده میشود. یادگیری عمیق میتواند به طور مستقیم بازنمایی پیچیدهی سیگنال را درک کرده و آموزش دهد و این قابلیت را دارد که به طور خودکار ویژگیهای پیشرفته موردنیاز برای کلاسبندی را استخراج کند.

در ده سال گذشته، یادگیری عمیق به طور گسترده در زمینههای مختلف پژوهشی مانند تشخیص گفتار، بینایی ماشین و پردازش زبان و همچنین در رمزگشایی سیگنال EEG استفاده شده است. در حال حاضر، شبکههایی که عمدتاً در رمزگشایی سیگنال EEG استفاده میشوند شامل انواع مختلف شبکه عصبی کانولوشنی (CNN)، شبکههای باور عمیق (DBN) و خودرمزنگار (AE) و شبکه عصبی بازگشتی (RNN) هستند.

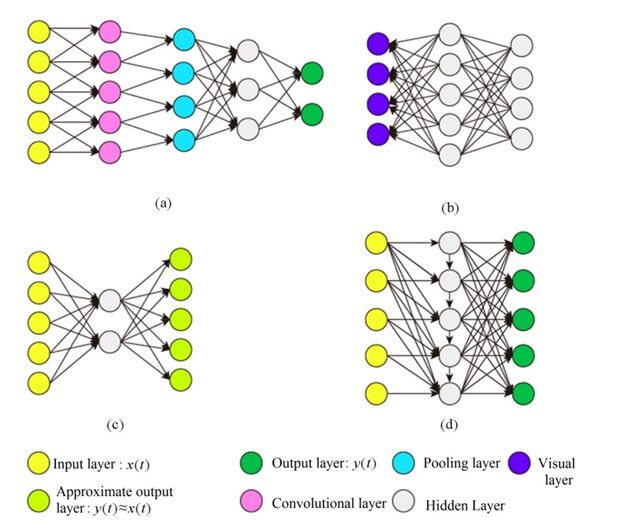

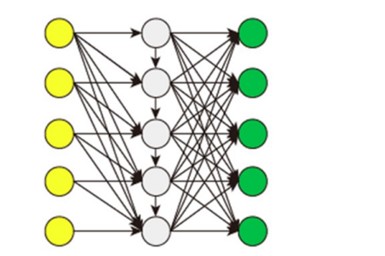

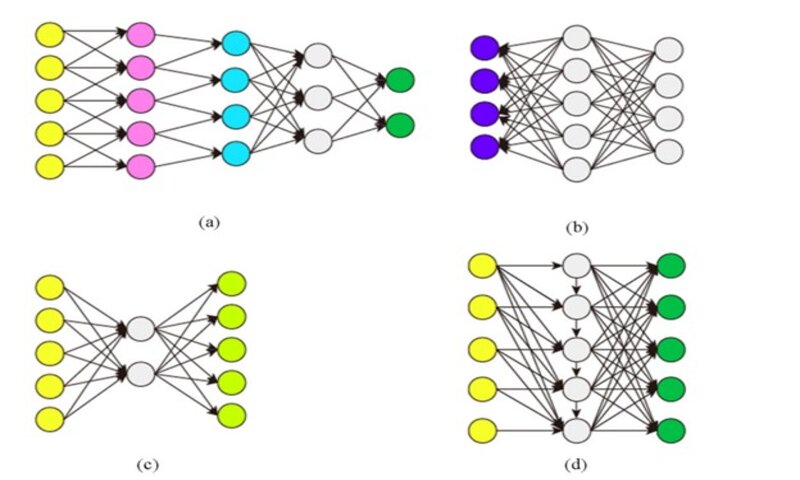

معماریهای مختلف برای الگوریتمهای یادگیری عمیق (a) CNN و (b) DBN و (c) AE و (d) RNN.

الف)شبکههای عصبی کانولوشنی (CNN)

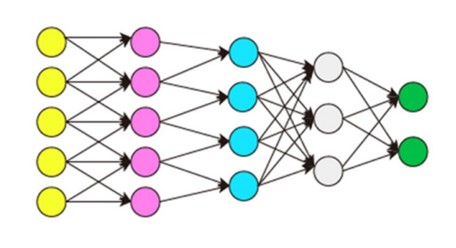

مدل شبکه عصبی مصنوعی یعنی CNN برای طبقه بندی تصاویر بسیار موثر عمل کرده است. مهمترین نکته در مورد این شبکهها آن است که از کانولوشن برای یادگیری الگوهای محلی در داده استفاده میکند. ساختار معمول CNN عمدتاً شامل سه لایه کانولوشنی سلسله مراتبی و Pooling است. کاربردهای مختلف CNN به تعداد متفاوتی از لایههای کانولوشن نیاز دارند. برای مثال یک ساختار کم عمق با تنها یک لایهی کانولوشن برای تشخیص گفتار استفاده میشود. یک ساختار عمیق با چندین لایه کانولوشن پیوسته حتی بیش از 1000 لایه برای یک شبکه residual استفاده میشود که برای طبقه بندی و تشخیص گرافیکهای پیچیده (مانند تصاویر پزشکی) استفاده میشود.

شبکه کانولوشن ابتدا تابع loss را از طریق forward propagation محاسبه میکند. برای آموزش شبکه، خطا با محاسبه گرادیان تصویر ورودی و با مشتق گرغتن از وزنهای کرنل کانولوشنی محاسبه میشود. CNN نه تنها عملکرد خوبی در رمزگشایی دارد بلکه برای آموزش تکراری نیز مناسب است. این شبکه میتواند تا حد زیادی مشکلات رمزگشایی ناشی از توزیع سیگنال در کاربردهای تجربی را بهبود دهد. بنابراین شبکه CNN مورد علاقه محققان EEG است. با این همه، CNN ممکن است false positive تولید کند. این مشکل به ویژه در بینایی ماشین مهم است. ثانیاً آموزش شبکههای CNN ممکن است به دادههای بیشتری نیاز داشته باشد. همچنین زمان بیشتری برای آموزش یک مدل ساده نیاز باشد. در نهایت شبکه شامل تعداد زیادی هاپیرپارامتر مانند لایهها یا نوع تابع فعالسازی است. که منجر به افزایش پیچیدگی محاسباتی میشود و در تنظیم پارامترها مشکل ایجاد میکند.

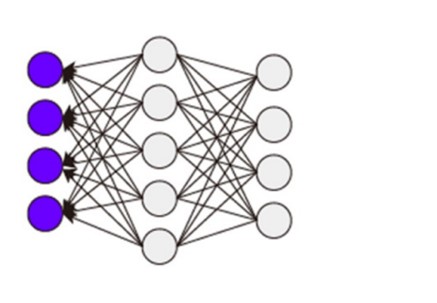

ب)شبکه باور عمیق

شبکه باور عمیق (DBN) یک مدل احتمالاتی مولد کلاسیک از ماشین های بولتزمن محدود (RBM) است. RBM یک مدل احتمالاتی عمیق است که شامل یک لایه قابل مشاهده و یک لایه پنهان است. اتصالات DBN محدود به لایههای مختلف هستند و هیچ اتصالی بین واحدهای یک لایه وجود ندارد. DBN یک پشته از چندین RBM است. دادههای با ابعاد بالا را میتوان از DBN عبور دارد. واحد لایه بصری، ورودی لایه پنهان RBM است و واحد لایه پنهان، انواع مختلف ویژگیهای سیگنال را با توجه به وزن اتصال تشخیص میدهد. وزن اتصالات RBM در DBN تنظیم شده است. ابتدا وزنها مطابق با افت احتمال تابع انرژی لایه قابل مشاهده و لایه پنهان تخصیص داده میشوند. سپس از یادگیری بدون نظارت لایه به لایه برای پیش آموزش وزنهای شبکه استفاده میشود و از یادگیری تحت نظارت برای تنظیم دقیق (fine_tune) استفاده میشود.

در حال حاضر، DBN به طور موفقیت آمیزی برای مسائلی چون کاهش ابعاد، فشرده سازی تصاویر، تشخیص دیجیتال و بازنمایی صوتی استفاده شده است. DBN نه تنها مزایای یادگیری بدون نظارت را دارد تا از دادههای بدون برچسب استفاده کند و همچنین به راحتی میتوان آن را برای دادههای با تعداد نمونههای کمتر استفاده کرد. بنابراین DBN میتواند نقش ویژهای در پژوهشهای آینده EEG بازی کند اما هنوز باید برخی از مسائل و مشکلات احتمالی آن بررسی شوند. اول از همه، DBN به عنوان یک نوع شبکه یادگیری عمیق به زمان زیادی برای آموزش نیاز دارد. دوماً با افزایش تعداد لایهها، حافظه و مقدار محاسبه افزایش مییابد و این مشکل در کاربردهای عملی انتظار نمیرود. در نهایت DBN آموزش دیده باید به عنوان یک مدل آموزش دیده باشد که بر انتقال موثر آن در کاربردهای cross-subject اثر داشته باشد.

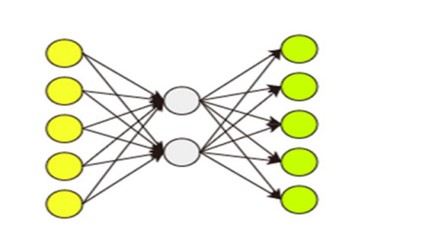

ج)خودرمزنگار (AE)

خودرمزنگار (AE) از یک تابع رمزگذار و تابع رمزگشا تشکیل شده است. سادهترین ساختار یک شبکه عصبی بدون سیکل feed forward مشابه MLP است. این شبکه دارای یک لایه ورودی، یک لایه خروجی و یک چارچوب پایه متشکل از چندین لایه پنهان است. AE یک شبکه عصبی یادگیری بدون نظارت است. این شبکه مقدار هدف را به مقدار مشابه ورودی تنظیم میکند و در پیش آموزش تسک کلاسبندی با یک بازنمایی خوب از دیتاست میتواند بهتر یاد بگیرد. در حال حاضر، با توجه به قابلیت AE برای بدست آوردن اطلاعات و یادگیری، انواع مختلف مدلهای خودرمزنگار وجود دارند مانند خودرمزنگار حذف نویز (DAE) و خودرمزنگارهای تنک (SAE) و خودرمزنگار انقباضی (CAE).

AE معمولاً برای کاهش ابعاد استفاده میشود اما بیشتر برای تولید مدلهایی برای یادگیری دادهها استفاده میشود.

AE به طور موثر میتواند ویژگیهای EEG را شناسایی کند بنابراین شبکههای AE به طور فزایندهای در رمزگشایی EEG استفاده میشوند. با این حال، اگر سیگنال مستقیماً به عنوان ورودی AE استفاده شود، ممکن است اطلاعات مجاور را از دست دهد که بر کیفیت رمزگشایی سیگنال اثر خواهد داشت. در عین حال، پژوهشهای جاری همچنین نشان میدهند که تأمین نیازهای برنامه با استفاده از چارچوب خاصی از AE دشوار است. لازم است با سایر الگوریتمهای پیشرفته ترکیب شود تا به بهترین عملکرد دست یابد.

د)شبکه عصبی بازگشتی

شبکه عصبی بازگشتی (RNN) برای پردازش داده توالی استفاده میشود. علاوه بر لایه ورودی و خروجی، RNN سادهتر همچنین شامل یک لایه پنهان خودمتصل (Self-Connected) است. برخلاف MLP که تنها نگاشت از ورودی به خروجی انجام میدهد، شبکه RNN میتواند نگاشت از تمام ورودیهای قبلی برای هر خروجی انجام دهد. با نیاز به کاربردهای عملی، محققان انواع مختلفی از چارچوبهای RNN را پیشنهاد کردهاند. RNN نه تنها اتصالات feed forward را فراهم میکند بلکه اتصالات feedback هم دارد. این شبکه هنگام پردازش سریهای زمانی و سیگنال EEG خیلی خوب عمل میکند. به طور همزمان، RNN میتواند به طور موثر از توالی ورودی و اطلاعات زمانی استفاده کند و بنابراین انتظار میرود که در آینده نقش بسیار مهمی در زمینه پژوهشهای EEG داشته باشد.

منبع: Vallabhaneni, R. B., Sharma, P., Kumar, V., Kulshreshtha, V., Reddy, K. J., Kumar, S. S., … & Bitra, S. K. (2021). Deep learning algorithms in eeg signal decoding application: a review. IEEE Access, 9, 125778-125786.

جالب بود