یادگیری عمیق

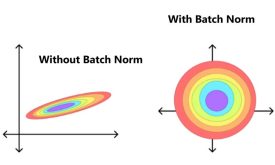

مفهوم Batch normalization در یادگیری عمیق

Batch Normalization یا نرمالسازی دستهای به عنوان یکی از تکنیکهای Generalization در یادگیری عمیق محسوب میشود که بطور مستقیم، در بهینهسازی مدلها نقش دارد. در واقع، پارامترهای ورودی را به کمک Adaptive normalization در مقیاسی مشابه قرار میدهد و اینگونه…

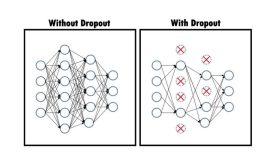

مفهوم Dropout در یادگیری عمیق

یکی از موانع بزرگ در الگوریتم های یادگیری عمیق، Overfitting است که برای مقابله با این پدیده، راهکارهای متعددی تاکنون توسط محققان ارائه شده است که در قالب تکنیکهای Generalization معرفی و در مقالات مورد استفاده قرار میگیرد. در این…

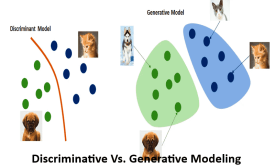

مدلسازی Generative در برابر Discriminative

از چشم انداز آکادمیکی، پیشرفتهای حاصل در discriminative modeling را سادهتر میتوان بررسی کرد؛ زیرا میتوانیم عملکرد شبکهها را با استفاده از معیارهای عملکردی، ارزیابی کنیم، اما ارزیابی مدلهای generative دشوار است. به خصوص زمانی که کیفیت خروجیهای تولید شده…

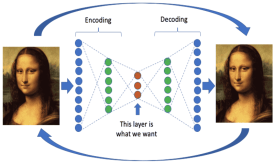

پیاده سازی یک autoencoder ساده در کراس

می خواهیم به نحوه ی پیاده سازی autoencoderها در کراس نگاهی بیندازیم، معماری شبکه عصبی که سعی می کند بازنمایی فشرده ای از داده ی ورودی به دست دهد.

شبکههای عمیق در نقشهای مختلف در تحلیل سیگنال EEG

اگر تابحال مقالات مربوط به کاربرد شبکههای عمیق در پردازش انواع مختلف سیگنال EEG را بررسی کرده باشید، احتمالاً متوجه شدهاید که بسته به کاربرد و عملکرد مناسب مدل، شبکههای عمیق در نقشهای مختلفی ظاهر شدهاند. برای مثال در برخی…

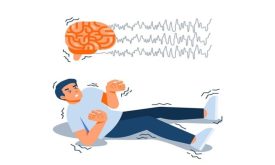

تشخیص تشنج های صرع سیگنال EEG با الگوریتم های یادگیری عمیق

در محیط بالینی، تشخیص خودکار تشنج های صرع اهمیت فزاینده ای پیدا می کند، زیرا می تواند به طور قابل توجهی بار مراقبت از بیماران مبتلا به صرع صعب العلاج را کاهش دهد. سیگنال های الکتروانسفالوگرافی (EEG) فعالیت الکتریکی مغز…

تنسورفلو یا پایتورچ، چرا PyTorch برای محققین انتخاب مناسبی است؟

تنسورفلو یا پایتورچ، مسئله این است! تنسورفلو (TensorFlow) و پایتورچ (PyTorch) دو پلتفرم قدرتمند یادگیری عمیق، به عبارت دو ستون اصلی در زمینه یادگیری عمیق هستند. تنسورفلو توسط گوگل توسعه پیدا کرده و به scalability و سازگاری مشهور است. در…

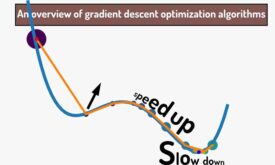

مطالعه مروری روشهای بهینهسازی مبتنی بر گرادیان نزولی

یادگیری در شبکههای عصبی به لطف مشتق و گرادیان نزولی(gradient descent) انجام میشه. در گرادیان نزولی، در هر تکرار آموزش شبکه عصبی شیب خطا محاسبه میشود و الگوریتم در جهت کاهش خطا حرکت میکند تا به حداقل خطای تصیمیم گیری…

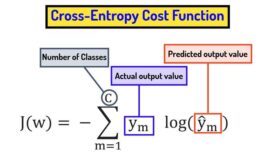

تابع هزینه cross entropy و تفاوت آن با مربعات خطا

تابع هزینه یک تابع ریاضیاتی است که عملکرد یک شبکه عصبی را در انجام یک تسک خاص اندازه گیری میکند. توابع هزینه نقش اساسی در یادگیری شبکه های عصبی دارند و به شبکه های عصبی کمک میکنند در راستای هدف…

مکانیزیم Attention در یادگیری عمیق

با پیچیدهتر شدن مدلهای یادگیری عمیق، نیاز به روشهای موثر پردازش میزان زیادی داده، اهمیت فزایندهای پیدا کرده است. یکی از این روشها، مکانیزیم توجه است که به مدل امکانی میدهد تا در هنگام پیش بینی بر مرتبطترین اطلاعات، تمرکز…

واسط مغز-کامپیوتر و الگوریتم های یادگیری عمیق

در حال حاضر کامپیوترها و مغزها هر روز در آزمایشگاههای فناوری پیشرفته با یکدیگر صحبت میکنند و هر روز این کار را بهتر و بهتر انجام میدهند. برای مثال افراد معلول میتوانند یاد بگیرند که با قدرت ذهن خود بر…

چالش های آموزش شبکههای عمیق و راه حل آنها

یادگیری عمیق و شبکههای عصبی از پیشرفتهترین و پرکاربردترین فناوریهای امروزی هستند. علیرغم پیشرفت قابل توجه آنها، هنوز چالشهای زیادی در یادگیری عمیق وجود دارد که محققان و متخصصان در تلاشند تا بر این چالشها غلبه کنند و مدلهای بهتری…